«Крестный отец ИИ»: Нас ждут экономические кризисы и войны с массовым применением автономного оружия

Лауреат премии Тьюринга и один из пионеров глубокого обучения, предупредил о неготовности человечества к последствиям стремительного развития искусственного интеллекта. Ученый заявил, что риски варьируются от экономической катастрофы до неконтролируемого распространения автономного оружия, а существующие социальные институты не справятся с этими вызовами без радикальных реформ.

Возможные будущие сценарии

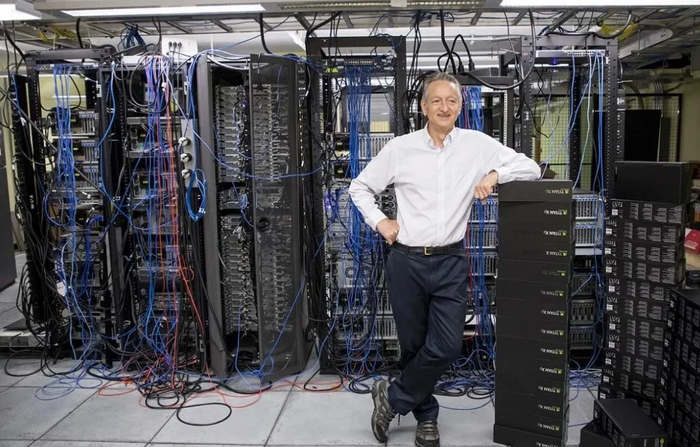

«Крестный отец искусственного интеллекта (ИИ)» Джеффри Хинтон (Geoffrey Hinton) считает, что мир не готов к последствиям из-за стремительного развития ИИ, об этом он заявил в ходе публичной дискуссии с американским сенатором Берни Сандерсом (Bernie Sanders). Мир ждет большие экономические кризисы и военные конфликты с массовым применением автономного оружия. Существующие же социальные институты в 2025 г. не справятся с вызовами от ИИ без радикальных реформ.

Джеффри Хинтон подчеркнул, что повсеместное внедрение ИИ-технологий неизбежно повысит производительность труда, но выгоду от этого получат преимущественно владельцы корпораций, а наемные работники столкнутся с массовыми сокращениями. По его мнению, рынок не сможет самостоятельно сбалансировать ситуацию, ведь правительствам придется вмешиваться в экономику, возможно, вводя безусловный базовый доход, чтобы предотвратить резкий рост неравенства.

Особую тревогу вызывает потенциальное военное применение ИИ-технологий. По словам эксперта, регулировать боевые нейронные сети и автономное оружие значительно сложнее, чем ядерное оружие. Если для создания атомной бомбы нужны огромные промышленные мощности и редкие изотопы, то автономные боевые системы управляются программным кодом. Его можно мгновенно скопировать, украсть или перенести на обычной флешке, что делает практически невозможным любой эффективный контроль над нераспространением таких технологий.

Ученый также вновь подчеркнул свои опасения по поводу экзистенциальных рисков, связанных с утратой контроля над ИИ. По мнению Джеффри Хинтона, когда ИИ превзойдет человека по уровню интеллекта, он сможет манипулировать людьми, чтобы достигать собственных целей, которые могут не совпадать с человеческими интересами и ценностями. Главная опасность, отметил он, заключается в том, что человечество вступает в эту эпоху без какого-либо четкого плана или механизмов защиты от подобных сценариев.

Это выступление стало продолжением серии тревожных заявлений, которые Хинтон начал делать после ухода из Google в 2023 г., о чем писал CNews. Он подчеркивает, что темпы развития ИИ-технологий за последние годы значительно превысили даже самые смелые прогнозы экспертов по ИИ-технологиям, и у общества уже не остается времени на привычную медленную бюрократическую адаптацию законов и правил.

Крестный отец ИИ-технологий

Британский и канадский ученый-программист и лауреат Нобелевской премии по физике Джеффри Хинтон, которого называют «крестным отцом ИИ-технологий», в конце декабря 2024 г. предупредил о серьезной угрозе со стороны нейронных сетей. Он оценил вероятность того, что ИИ-технологии могут привести попросту к вымиранию человечества к 2055-2060 г., в диапазоне от 10 до 20% от всего мирового населения Земли. «Понимаете, нам никогда не приходилось иметь дело с чем-то более разумным, чем мы сами», — сказал ученый-программист.

Джеффри Хинтон занимается развитием нейронных сетей с 1970 г. В 2012 г. его ИТ-компанию, разработавшую технологию распознавания изображений, Google приобрела за $44 млн. Среди сотрудников Хинтона был и Илья Суцкевер (Ilya Sutskever), который позже стал главным научным сотрудником OpenAI, компании-разработчика чат-бота ChatGPT.

В 2023 г. Хинтон покинул Google, чтобы свободно высказываться о рисках, связанных с развитием ИИ. Он уверен, что ИИ способен выйти из-под человеческого контроля и превратиться в экзистенциальную угрозу. Ученый постоянно выступает за поиск решений, которые обеспечат мирное сосуществование людей и ИИ. Например, он предложил радикальный подход к управлению сверхинтеллектом: вместо попыток доминировать над ИИ-технологиями, следует сделать так, чтобы он заботился о людях, подобно матери, опекающей ребенка. «Мать управляется ребенком», — отметил Хинтон, считая это единственным известным случаем, когда более разумное существо подчиняется менее разумному.

Автоматизация профессий, потом автономность

Множество исследований и отчетов прогнозировали, что ИИ в будущем заменит людей в таких областях, как бухгалтерия, контент-менеджмент или работа операторов колл-центров.

Появление агентского ИИ в 2024 г. стало важным шагом в эволюции технологии. В отличие от генеративных ИИ-моделей, такой ИИ способен выполнять конкретные действия, справляясь с неопределенностью в данных и автономно принимая решения на основе контекста.

При этом разрыв между компаниями-лидерами и отстающими будет стремительно увеличиваться. По мере совершенствования и апробации ИИ-технологии, будут появляться ИИ-агенты, способные выполнять все более сложные задачи, причем все точнее и точнее. Это неизбежно приведет к тому, что некоторые профессии будут отмирать и трансформироваться.

По своей сути Джеффри Хинтон в ноябре 2025 г., предупреждает о том, что для всего развития есть свои социальные последствия. Это не означает массовой безработицы, но приведет к глубокой перестройке рынка труда. Как писал CNews, в России эти процессы тоже начались, крупнейшие банки, промышленные холдинги и медицинские компании внедряют генеративные решения в бизнес-процессы, что требует новых компетенций и иной культуры управления.

Но в фокусе уже следующее поколение — универсальный или общий ИИ или же Artificial General Intelligence (AGI), который потенциально сможет решать любые задачи, обучаться без подсказок и, по мнению аналитиков Gartner, проявится уже к 2035 г. Главные угрозы AGI связаны с его автономностью. Если ИТ-система способна самостоятельно улучшать свои способности, возникает риск интеллектуального взрыва — ситуации, когда скорость развития машины превышает человеческое понимание. Именно поэтому мировые исследовательские центры DeepMind и OpenAI параллельно с ИИ-архитектурами работают над решением так называемого alignment problem — задачи согласования целей машины с человеческими ценностями.

Поделиться

Поделиться